هوش مصنوعی وارد دنیای موسیقی نیز شده است

مدلهای نوین «دیفیوشن» که قادرند از ابتدا یک آهنگ خلق کنند، مفهوم نویسندگی و خلاقیت انسانی را پیچیدهتر از پیش کردهاند.

هوش مصنوعی در سال ۱۹۵۶ هنوز حتی بهدرستی بهعنوان یک اصطلاح شناخته نشده بود، زمانی که دانشمندان برجسته حوزه محاسبات برای یک کنفرانس تابستانی به کالج دارتموث آمدند. جان مککارتی، دانشمند علوم کامپیوتر، این عبارت را در پیشنهاد تأمین مالی این رویداد ابداع کرده بود—نشستی برای بررسی اینکه چگونه میتوان ماشینهایی ساخت که بتوانند از زبان استفاده کنند، مشکلات را مانند انسان حل کنند و توانایی بهبود خود را داشته باشند. اما این انتخاب خوبی بود، چرا که ایده بنیادی برگزارکنندگان را بهخوبی بیان میکرد: هر ویژگیای از هوش انسانی را میتوان «در اصل چنان دقیق توصیف کرد که ساخت ماشینی برای شبیهسازی آن ممکن باشد.»

در این پیشنهاد، گروه برگزارکننده چندین «جنبه از مسئله هوش مصنوعی» را فهرست کرده بودند. آخرین مورد در فهرست آنها—و از نگاه امروز شاید دشوارترینشان—ساخت ماشینی بود که بتواند خلاقیت و اصالت از خود نشان دهد.

در آن زمان، روانشناسان درگیر این پرسش بودند که چگونه میتوان خلاقیت را در انسان تعریف و اندازهگیری کرد. نظریه غالب آن دوران—که خلاقیت حاصل هوش و بهره هوشی بالا است—در حال از بین رفتن بود، اما روانشناسان هنوز جایگزینی مشخص برای آن نداشتند. برگزارکنندگان دارتموث دیدگاه خاص خود را داشتند. آنها نوشتند: «تفاوت بین تفکر خلاق و تفکر ماهرانه اما بدون تخیل در تزریق مقداری تصادف نهفته است»، و افزودند که چنین تصادفی «باید با شهود هدایت شود تا کارآمد باشد.»

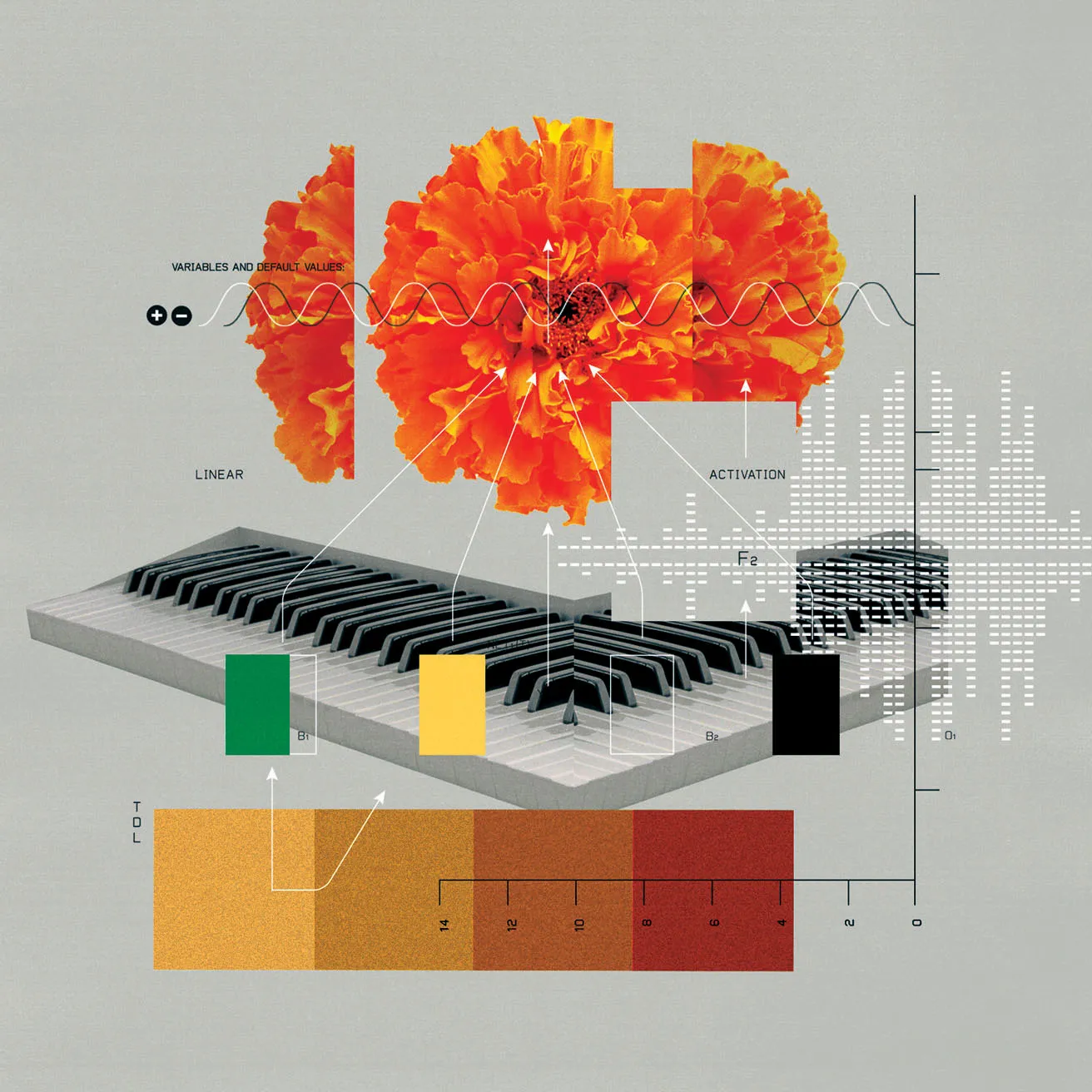

اکنون، پس از حدود ۷۰ سال و پشت سر گذاشتن چندین چرخه رونق و رکود در این حوزه، مدلهای هوش مصنوعیای در اختیار داریم که کموبیش از همین دستورالعمل پیروی میکنند. در حالیکه مدلهای زبانی بزرگ تولیدکننده متن در سه سال اخیر رشد چشمگیری داشتهاند، نوعی دیگر از هوش مصنوعی—مبتنی بر آنچه «مدلهای انتشاری» (diffusion models) خوانده میشود—تأثیری بیسابقه بر حوزههای خلاقانه گذاشته است. این مدلها با تبدیل نویز تصادفی به الگوهای منسجم، میتوانند تصاویر، ویدیوها یا گفتار جدیدی تولید کنند که با استفاده از دستورات متنی یا دادههای ورودی دیگر هدایت میشوند. بهترین این مدلها قادرند خروجیهایی بسازند که از آثار انسانها قابل تشخیص نیست، و در عین حال نتایجی عجیب، سوررئال و بهشکلی خاص غیرانسانی تولید میکنند.

اکنون این مدلها وارد حوزهای خلاقانه شدهاند که شاید بیش از هر زمینهی دیگری در معرض دگرگونی باشد: موسیقی. آثار خلاقانهای که توسط هوش مصنوعی تولید میشوند—از اجراهای ارکسترال گرفته تا موسیقی هِویمتال—در آستانهاند که بیش از هر محصول دیگری از هوش مصنوعی، زندگی ما را فرا بگیرند. این ترانهها بهاحتمال زیاد در پلتفرمهای استریم موسیقی، فهرستهای پخش مهمانیها و مراسم عروسی، موسیقی متن فیلمها و غیره جای خواهند گرفت—چه متوجه شویم چه نه که سازنده آنها چه کسی (یا چه چیزی) بوده است.

سالهاست که مدلهای پخشی بحثهایی را در دنیای هنرهای تجسمی برانگیختهاند: آیا آنچه تولید میکنند، بازتابی از خلاقیت واقعی است یا صرفاً تکرار آثار پیشین؟ اکنون این بحث به موسیقی رسیده است—هنری که بهشدت در تجربهها، خاطرهها و زندگی اجتماعی ما ریشه دارد. مدلهای موسیقی اکنون قادرند ترانههایی خلق کنند که واکنشهای عاطفی واقعی را در شنونده برمیانگیزند، و این خود نمونهای آشکار از چالش فزاینده در تعریف اصالت و مالکیت آثار در عصر هوش مصنوعی است.

دادگاهها نیز بهطور فعال درگیر این حوزهی مبهم شدهاند. شرکتهای بزرگ ضبط موسیقی از تولیدکنندگان اصلی موسیقی با هوش مصنوعی شکایت کردهاند و مدعیاند که این مدلهای پخشی در اصل چیزی جز تکرار هنر انسانی، بدون پرداخت حقالزحمه به هنرمندان، انجام نمیدهند. در مقابل، سازندگان این مدلها پاسخ میدهند که ابزارهایشان برای کمک به خلق انسانی ساخته شدهاند.

در تلاش برای تعیین اینکه چه کسی در این مناقشه حق دارد، ناچار میشویم دربارهی خلاقیت انسانی خودمان عمیقتر فکر کنیم. آیا خلاقیت—چه در شبکههای عصبی مصنوعی و چه در مغز انسان—تنها حاصل یادگیری آماری گسترده و ارتباطسازیهای وسیع است، با چاشنیای از تصادف؟ اگر چنین باشد، مالکیت اثر مفهومی لغزنده خواهد بود. و اگر نه—اگر خلاقیت دارای عنصری بهطور خاص انسانی باشد—آن عنصر چیست؟ آیا میتوان تحت تأثیر اثری قرار گرفت که خالقی انسانی نداشته باشد؟ من زمانی برای نخستینبار با این پرسشها مواجه شدم که آهنگی تولیدشده توسط هوش مصنوعی شنیدم که واقعاً فوقالعاده بود—و دانستن اینکه کسی فقط یک فرمان نوشته و روی دکمه «تولید» کلیک کرده، احساسی ناخوشایند داشت. بهزودی این تجربه برای شما هم پیش خواهد آمد.

ایجاد پیوندها

پس از کنفرانس دارتموث، شرکتکنندگان مسیرهای پژوهشی گوناگونی را برای خلق فناوریهای بنیادین هوش مصنوعی در پیش گرفتند. همزمان، دانشمندان علوم شناختی بهدنبال فراخوانی از سوی جی.پی. گیلفورد، رئیس وقت انجمن روانشناسی آمریکا در سال ۱۹۵۰، به بررسی پرسش خلاقیت در انسانها پرداختند. آنها به تعریفی رسیدند که نخستین بار در سال ۱۹۵۳ توسط روانشناس موریس استاین در مجله روانشناسی رسمی شد: آثار خلاقانه باید هم «نو» باشند، یعنی چیز تازهای ارائه دهند، و هم «مفید»، یعنی برای کسی کاربردی داشته باشند. برخی پیشنهاد دادهاند که واژه «مفید» با «رضایتبخش» جایگزین شود و برخی دیگر خواهان افزودن معیار سومی شدهاند: اینکه آثار خلاقانه همچنین باید «غافلگیرکننده» باشند.

در دهه ۱۹۹۰، ظهور فناوری تصویربرداری تشدید مغناطیسی کارکردی (fMRI) امکان مطالعه بیشتر درباره سازوکارهای عصبی زیربنای خلاقیت را در حوزههای مختلف، از جمله موسیقی، فراهم کرد. روشهای محاسباتی در چند سال گذشته نیز درک ما از نقش حافظه و تفکر تداعیمحور در تصمیمگیریهای خلاقانه را تسهیل کردهاند.

آنچه تاکنون پدید آمده، نه یک نظریه واحد و فراگیر درباره چگونگی پیدایش و گسترش ایدههای خلاقانه در مغز، بلکه فهرستی روبهرشد از مشاهدات نیرومند است. میتوان فرآیند خلاقانه انسانی را به مراحل گوناگونی تقسیم کرد، از جمله مرحله ایدهپردازی یا پیشنهاد اولیه، و سپس مرحلهای انتقادیتر و ارزیابانه که به بررسی ارزش آن ایدهها میپردازد. یکی از نظریههای پیشرو درباره راهنمایی این دو مرحله، «نظریه تداعیمحور خلاقیت» نام دارد که بیان میکند افراد خلاقتر میتوانند میان مفاهیم دور از هم، پیوندهایی تازه برقرار کنند.

راجر بیتی، پژوهشگری که آزمایشگاه علوم اعصاب شناختی خلاقیت در دانشگاه ایالتی پنسیلوانیا را اداره میکند، میگوید:

«این فرآیند میتواند شبیه به پراکندگی فعالسازی باشد. یعنی وقتی به چیزی فکر میکنید، آن فکر مفاهیم مرتبط با خودش را بهطور خودکار فعال میکند.»

این پیوندها اغلب بهویژه بر حافظه معنایی متکیاند—نوعی از حافظه که مفاهیم و واقعیتها را ذخیره میکند، برخلاف حافظه رویدادی که خاطرات مربوط به زمان و مکان خاصی را نگه میدارد. در سالهای اخیر، مدلهای محاسباتی پیشرفتهتری برای مطالعه چگونگی ایجاد پیوند میان مفاهیم با «فاصله معنایی» زیاد استفاده شدهاند. بهعنوان مثال، واژهی «آخرالزمان» از نظر معنایی به «انرژی هستهای» نزدیکتر است تا به «جشن». مطالعات نشان دادهاند که افراد خلاق ممکن است مفاهیم بسیار متفاوت از نظر معنایی را بهصورت مفاهیمی نزدیک درک کنند. همچنین مشخص شده که هنرمندان در مقایسه با افراد غیرهنرمند، ارتباطات کلامی با فواصل معنایی بیشتری ایجاد میکنند. تحقیقات دیگر نیز از این ایده حمایت کردهاند که افراد خلاق دارای نوعی «توجه نشتدار» هستند—یعنی آنها اغلب اطلاعاتی را میبینند یا درک میکنند که لزوماً به کار فوریشان مربوط نیست.

روشهای علوم اعصاب برای ارزیابی این فرآیندها نشان نمیدهند که خلاقیت در ناحیهای خاص از مغز شکل میگیرد. دین کیت سیمونتون، از پژوهشگران برجسته در زمینه خلاقیت، در راهنمای علوم اعصاب خلاقیت کمبریج مینویسد:

«هیچ چیز در مغز انسان خلاقیت تولید نمیکند، همانطور که یک غده، هورمون ترشح میکند.»

بیتی میگوید که شواهد بهجای آن، به وجود چند شبکهی پراکندهی فعالیت عصبی در هنگام تفکر خلاق اشاره دارند—یک شبکه برای پشتیبانی از تولید اولیه ایدهها از طریق تفکر تداعیمحور، شبکهای دیگر برای شناسایی ایدههای امیدبخش، و شبکهای دیگر برای ارزیابی و اصلاح آنها. مطالعهای جدید که توسط پژوهشگرانی از دانشکده پزشکی هاروارد انجام شده و در فوریه منتشر شده، نشان میدهد که خلاقیت حتی ممکن است شامل سرکوب برخی شبکههای مغزی باشد—برای مثال، شبکههایی که در سانسور ذهنی و خودکنترلی دخیل هستند.

تا اینجا، خلاقیت ماشینی—اگر بتوان آن را خلاقیت نامید—ظاهر کاملاً متفاوتی دارد. در زمان کنفرانس دارتموث، پژوهشگران هوش مصنوعی به ساخت ماشینهایی علاقهمند بودند که از مغز انسان الهام گرفته باشند، اما این تمرکز تا زمانی که مدلهای پخشی حدود یک دهه پیش معرفی شدند، تغییر کرده بود.

بهترین سرنخ برای درک نحوه عملکرد این مدلها در خود نام آنهاست. اگر قلممویی آغشته به جوهر قرمز را درون یک لیوان آب فرو ببرید، جوهر بهطور تصادفی در آب پخش میشود و در نهایت مایعی صورتیرنگ پدید میآید. مدلهای پخشی این فرایند را برعکس شبیهسازی میکنند—یعنی از دلِ تصادف و آشوب، فرمهایی قابل تشخیص بازسازی میکنند.

برای درک نحوه عملکرد این مدلها در تولید تصاویر، عکسی از یک فیل را تصور کنید. برای آموزش مدل، ابتدا نسخهای از این عکس تهیه کرده و لایهای از نویز سیاه و سفید تصادفی به آن اضافه میکنیم. سپس نسخه دوم با نویز بیشتری تولید میشود، و این روند صدها بار تکرار میشود تا در نهایت آخرین تصویر کاملاً نویزی شده و دیگر هیچ فیلی در آن قابل تشخیص نیست. در هر مرحله، یک مدل آماری پیشبینی میکند که چه میزان از تصویر نویز است و چه میزان واقعاً مربوط به فیل است. سپس با مقایسه پیشبینیها با پاسخهای درست، از اشتباهات خود میآموزد. با میلیونها مثال مشابه، مدل در حذف نویز و اتصال الگوها به توصیفهایی مانند «فیل نر بورنئویی در دشتی باز» بهتدریج به مهارت میرسد.

حالا که مدل آموزش دیده، تولید یک تصویر جدید یعنی اجرای همین فرآیند بهصورت معکوس. اگر فرمانی مانند «یک اورانگوتان خوشحال در جنگلی پوشیده از خزه» به مدل بدهید، ابتدا تصویری کاملاً نویزی ایجاد میکند و سپس با استفاده از مدل آماریاش، مرحلهبهمرحله نویز را حذف میکند. در ابتدا شکلها و رنگهایی مبهم پدیدار میشوند، سپس جزئیات ظاهر میگردند، و در نهایت (اگر مدل موفق عمل کند) تصویری از یک اورانگوتان پدید میآید—همهی اینها بدون آنکه مدل «بداند» اورانگوتان چیست.

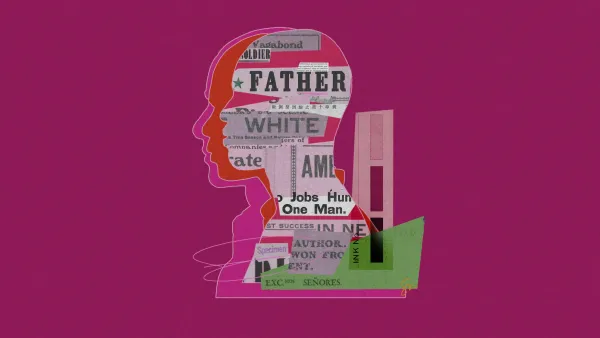

تصاویر موسیقی

این رویکرد برای موسیقی به همان شیوه عمل میکند. مدل پخشی یک آهنگ را بهطور مشابه با روشی که یک گروه موسیقی ممکن است بسازد، نمیآفریند، که در آن ابتدا آکوردهای پیانو آغاز شده و سپس آواز و درامها اضافه میشوند. در عوض، تمام عناصر بهطور همزمان تولید میشوند. این فرآیند به این واقعیت وابسته است که پیچیدگیهای بسیاری از یک آهنگ را میتوان بهطور بصری در یک موج صوتی واحد نشان داد، که نمایانگر دامنهی موج صوتی است که در برابر زمان ترسیم میشود.

تصور کنید یک دستگاه پخش گرامافون را. با حرکت کردن در یک شیار روی یک صفحه وینیل، سوزن مسیر امواج صوتی حکشده در ماده را بازتاب میدهد و آن را به سیگنال صوتی برای بلندگو منتقل میکند. بلندگو تنها هوا را در این الگوها به بیرون میفشارد و امواج صوتی تولید میکند که کل آهنگ را منتقل میکند.

از فاصلهای دور، ممکن است یک موج صوتی به نظر برسد که فقط حجم آهنگ را دنبال میکند. اما اگر شما به اندازه کافی نزدیک شوید، میتوانید الگوهایی را در قلهها و درهها مشاهده کنید، مانند ۴۹ موج در ثانیه برای یک گیتار باس که نت جی پایین را مینوازد. یک موج صوتی مجموع فرکانسهای تمام سازها و بافتهای مختلف را در خود دارد. دیوید دینگ، یکی از بنیانگذاران شرکت موسیقی هوش مصنوعی Udio، میگوید: «شما میبینید که اشکال خاصی شروع به شکلگیری میکنند» و «این به نوعی با حس ملودیک وسیعتر همخوانی دارد.»

از آنجا که موجهای صوتی یا نمودارهای مشابهی که به آنها اسپکتروگرام گفته میشود، میتوانند مانند تصاویر مورد استفاده قرار گیرند، میتوان از آنها یک مدل پخشی ساخت. مدل با میلیونها قطعه از آهنگهای موجود که هرکدام با یک توصیف برچسبگذاری شدهاند، تغذیه میشود. برای تولید یک آهنگ جدید، این مدل با نویز تصادفی خالص آغاز میکند و بهطور معکوس برای ایجاد یک موج صوتی جدید کار میکند. مسیری که برای انجام این کار طی میکند، تحت تأثیر کلماتی است که شخص در درخواست وارد میکند.

دینگ پنج سال در گوگل دیپمایند بهعنوان مهندس ارشد تحقیقاتی مدلهای پخشی برای تصاویر و ویدیوها کار کرده بود، اما در سال ۲۰۲۳ از آنجا استعفا داد تا شرکت Udio را در نیویورک تأسیس کند. این شرکت و رقیب آن، Suno، مستقر در کمبریج، ماساچوست، هماکنون در حال پیشی گرفتن در رقابت مدلهای تولید موسیقی هستند. هر دو شرکت هدف دارند تا ابزارهای هوش مصنوعی بسازند که به افراد غیرموسیقیدان اجازه دهند موسیقی بسازند. شرکت Suno بزرگتر است و ادعا میکند که بیش از ۱۲ میلیون کاربر دارد و در ماه مه ۲۰۲۴ یک دور تأمین سرمایه ۱۲۵ میلیون دلاری انجام داده است. این شرکت با هنرمندانی از جمله تیمبالند همکاری کرده است. Udio در آوریل ۲۰۲۴ یک دور تأمین سرمایه ۱۰ میلیون دلاری از سرمایهگذاران برجسته مانند Andreessen Horowitz و همچنین موسیقیدانان Will.i.am و Common جذب کرده است.

نتایج Udio و Suno تا به حال نشان میدهند که مخاطبان زیادی وجود دارند که ممکن است اهمیتی ندهند که آیا موسیقیای که گوش میدهند توسط انسانها یا ماشینها ساخته شده است. شرکت Suno صفحات هنرمندان را برای خالقانی دارد که برخی از آنها دنبالکنندگان زیادی دارند و آهنگها را بهطور کامل با هوش مصنوعی تولید میکنند، اغلب همراه با تصاویری از هنرمند که توسط هوش مصنوعی ایجاد شدهاند. این خالقان بهطور معمول موسیقیدان نیستند، بلکه افرادی ماهر در ایجاد درخواستها هستند، و آثارشان را نمیتوان به یک آهنگساز یا خواننده خاص نسبت داد. در این فضای نوظهور، تعاریف معمول ما از مالکیت اثر—و مرزهای میان آفرینش و تکرار—تقریباً محو میشود.

نتایج Udio و Suno تا به حال نشان میدهند که مخاطبان زیادی وجود دارند که ممکن است اهمیتی ندهند که آیا موسیقیای که گوش میدهند توسط انسانها یا ماشینها ساخته شده است.

صنعت موسیقی در حال واکنش است. هر دو شرکت در ژوئن ۲۰۲۴ توسط برچسبهای ضبط موسیقی بزرگ شکایت شدند و این پروندهها همچنان ادامه دارند. این برچسبها، از جمله یونیورسال و سونی، ادعا میکنند که مدلهای هوش مصنوعی بر روی موسیقیهای دارای حق نشر "در مقیاسی تقریباً غیرقابل تصور" آموزش داده شدهاند و آهنگهایی تولید میکنند که "ویژگیهای ضبطهای صوتی انسان واقعی را تقلید میکنند" (پرونده علیه Suno به یک آهنگ شبیه ABBA به نام "Prancing Queen" اشاره میکند).

Suno به درخواستها برای اظهار نظر در مورد دعوی قانونی پاسخ نداد، اما در بیانیهای که در آگوست بر روی وبلاگ Suno منتشر شد، مدیرعامل Mikey Shulman گفت که این شرکت بر روی موسیقیهای موجود در اینترنت آزاد آموزش میدهد که "درست است که شامل مواد دارای حق نشر است." اما او استدلال کرد که "یادگیری نقض حقوق نیست."

نمایندهای از Udio گفت که شرکت در مورد دعاوی قانونی در حال بررسی اظهار نظر نخواهد کرد. در زمان دعوی، Udio بیانیهای منتشر کرد که در آن اشاره کرد که مدل این شرکت فیلترهایی دارد تا اطمینان حاصل کند که "آثار دارای حق نشر یا صداهای هنرمندان را بازتولید نمیکند."

موضوع را حتی پیچیدهتر کرده است راهنماییهایی که دفتر حقوق نویسندگان ایالات متحده در ژانویه منتشر کرد که میگوید آثار تولید شده توسط هوش مصنوعی در صورتی که شامل مقدار قابل توجهی از ورودی انسانی باشد، میتوانند دارای حق نشر باشند. یک ماه بعد، یک هنرمند در نیویورک اولین حق نشر را برای یک اثر هنری تصویری ساخته شده با کمک هوش مصنوعی دریافت کرد. شاید اولین آهنگ هم در نوبت باشد.

نوآوری و تقلید

این پروندههای قانونی وارد یک حوزه خاکستری مشابه با نبردهای قضایی دیگری میشوند که در زمینه هوش مصنوعی در حال وقوع است. مسئله این است که آیا آموزش مدلهای هوش مصنوعی بر روی محتوای دارای حق نشر مجاز است و آیا آهنگهای تولید شده بهطور ناعادلانهای سبک هنرمندان انسانی را تقلید میکنند.

اما احتمالاً موسیقی هوش مصنوعی به هر صورت در حال گسترش است، صرف نظر از این تصمیمات قضائی؛ گزارشها حاکی از آن است که یوتیوب در حال گفتگو با برچسبهای بزرگ برای اخذ مجوز موسیقیهایشان برای آموزش هوش مصنوعی است و گسترش اخیر قراردادهای متا با Universal Music Group نشان میدهد که ممکن است مجوزهایی برای موسیقیهای تولید شده توسط هوش مصنوعی در دسترس باشد.

اگر موسیقی هوش مصنوعی قرار است بماند، آیا هیچیک از آنها خوب خواهند بود؟ سه عامل را در نظر بگیرید: دادههای آموزشی، خود مدل پخشی و درخواستها. مدل تنها به اندازه کتابخانه موسیقیای که از آن یاد میگیرد و توصیفاتی که از آن موسیقیها میشود، میتواند خوب باشد، که باید پیچیده باشند تا بهخوبی آن را ضبط کنند. معماری مدل سپس تعیین میکند که چگونه میتواند از آنچه آموخته شده برای تولید آهنگها استفاده کند. و درخواست شما که وارد مدل میکنید—و همچنین به اندازهای که مدل "میفهمد" که منظور شما از "کم کردن صدای ساکسوفون" چیست—همچنین نقشی اساسی دارد.

آیا نتیجه ایجاد است یا صرفاً کپیبرداری از دادههای آموزشی؟ ما میتوانیم همین سؤال را در مورد خلاقیت انسانی نیز بپرسیم.

مهمترین مسئله احتمالاً سؤال اول است: دادههای آموزشی چقدر گسترده و متنوع هستند و چقدر بهخوبی برچسبگذاری شدهاند؟ نه Suno و نه Udio مشخص نکردهاند که چه موسیقیهایی در مجموعه آموزشی آنها قرار دارد، هرچند احتمالاً این جزئیات باید در طول دعویهای قانونی افشا شوند.

Udio میگوید که نحوه برچسبگذاری این آهنگها برای مدل بسیار مهم است. "یکی از زمینههای تحقیقاتی فعال برای ما این است که چگونه میتوانیم توصیفهای دقیقتر و دقیقتری از موسیقی بدست آوریم؟" Ding میگوید. یک توصیف ابتدایی میتواند ژانر را شناسایی کند، اما سپس میتوانید بگویید که آیا یک آهنگ غمگین است، امیدوارکننده است یا آرام. توصیفهای فنیتر ممکن است شامل پیشرفت آکورد دو-پنج-یک یا یک مقیاس خاص باشند. Udio میگوید که این کار را از طریق ترکیب برچسبگذاری ماشین و انسان انجام میدهد.

"چون ما میخواهیم طیف وسیعی از کاربران هدف را هدف قرار دهیم، این به این معنی است که ما به مجموعهای گسترده از برچسبگذاران موسیقی نیاز داریم، نه فقط افرادی که دکتری موسیقی دارند و میتوانند موسیقی را در سطح بسیار فنی توصیف کنند، بلکه همچنین علاقهمندان به موسیقی که واژگان غیررسمی خود را برای توصیف موسیقی دارند."

ژنراتورهای موسیقی هوش مصنوعی رقابتی نیز باید از یک عرضه مداوم آهنگهای جدیدی که توسط انسانها ساخته میشوند، یاد بگیرند وگرنه خروجیهای آنها در زمان گیر خواهند کرد و به نظر قدیمی و تکراری خواهند آمد. برای این منظور، موسیقی تولید شده توسط هوش مصنوعی امروزه به هنر تولید شده توسط انسانها وابسته است. اما در آینده، مدلهای موسیقی هوش مصنوعی ممکن است از خروجیهای خود آموزش ببینند، رویکردی که در دیگر حوزههای هوش مصنوعی در حال آزمایش است.

چون مدلها با نمونهبرداری تصادفی از نویز شروع میکنند، غیرقطعی هستند؛ دادن همان درخواست به مدل هوش مصنوعی باعث میشود که هر بار آهنگ جدیدی تولید شود. این به این دلیل است که بسیاری از سازندگان مدلهای پخشی، از جمله Udio، تصادفی بودن اضافی را از طریق فرآیند وارد میکنند—در واقع، آنها فرم موجنمایی که در هر مرحله تولید میشود را کمی تحریف میکنند به امید افزودن نقصهایی که به خروجی جذابتر یا واقعیتر میشود. برگزارکنندگان کنفرانس Dartmouth خودشان در سال ۱۹۵۶ چنین تاکتیکی را توصیه کرده بودند.

طبق گفته اندرو سانچز، همبنیانگذار و مدیر عملیات Udio، این تصادفی بودن در برنامههای تولیدی هوش مصنوعی است که برای بسیاری از مردم شوکهکننده است. برای ۷۰ سال گذشته، کامپیوترها برنامههای قطعی اجرا کردهاند: ورودی را به نرمافزار بدهید و هر بار همان پاسخ را دریافت کنید.

"بسیاری از هنرمندان شریک ما میگویند، 'خب، چرا این کار را انجام میدهد؟'" او میگوید. "ما میگوییم، خب، ما واقعاً نمیدانیم." عصر تولیدی به ذهنیتی جدید نیاز دارد، حتی برای شرکتهایی که آن را ایجاد میکنند: اینکه برنامههای هوش مصنوعی میتوانند آشفته و غیرقابل فهم باشند.

آیا نتیجه ایجاد است یا صرفاً کپیبرداری از دادههای آموزشی؟ طرفداران موسیقی هوش مصنوعی به من گفتند که میتوانیم همین سؤال را در مورد خلاقیت انسانی بپرسیم. همانطور که ما موسیقی را در دوران جوانی خود میشنویم، مکانیسمهای عصبی برای یادگیری تحت تأثیر این ورودیها قرار میگیرند و خاطرات این آهنگها بر خروجیهای خلاقانه ما تأثیر میگذارند. در یک مطالعه اخیر، آنتونی برندت، آهنگساز و استاد موسیقی در دانشگاه رایس، اشاره کرد که هم انسانها و هم مدلهای زبان بزرگ از تجربیات گذشته برای ارزیابی سناریوهای آینده و اتخاذ تصمیمات بهتر استفاده میکنند.

در حقیقت، بسیاری از هنرهای انسانی، بهویژه در موسیقی، وام گرفته شده است. این اغلب منجر به دعویهای قانونی میشود، با هنرمندانی که ادعا میکنند یک آهنگ بدون اجازه کپی یا نمونهبرداری شده است. برخی از هنرمندان پیشنهاد میکنند که مدلهای پخشی باید شفافتر شوند تا بتوانیم بدانیم که الهامبخش یک آهنگ خاص سه قسمت دیوید بویی و یک قسمت لو رید بوده است. Udio میگوید که تحقیقات در حال انجام است تا این کار انجام شود، اما در حال حاضر، هیچکس نمیتواند این کار را بهطور قابل اعتماد انجام دهد.

برای هنرمندان بزرگ، "ترکیب نوآوری و تأثیر است که در کار است"، سانچز میگوید. "و من فکر میکنم که این چیزی است که در این فناوریها نیز در حال کار است."

اما در بسیاری از زمینهها تلاشها برای معادلسازی شبکههای عصبی انسانی با شبکههای مصنوعی به سرعت تحت بررسی از هم میپاشند. برندت یک حوزه را مشخص میکند که در آن خلاقیت انسانی بهوضوح از آثار ساخته شده توسط ماشینها پیشی میگیرد: چیزی که او "تقویت انحراف" مینامد. مدلهای هوش مصنوعی در قلمرو نمونهبرداری آماری عمل میکنند. آنها نه با تأکید بر استثنائات بلکه با کاهش خطاها و یافتن الگوهای محتمل عمل میکنند. انسانها، از طرف دیگر، از ویژگیهای عجیب و غریب هیجانزده میشوند. "به جای اینکه به عنوان رویدادهای عجیب یا 'یکبار مصرف' درمان شوند"، برندت مینویسد، ویژگیهای عجیب و غریب "در سراسر محصول خلاقانه نفوذ میکند."

او به تصمیم بتهوون برای اضافه کردن نت آزاردهنده و خارج از تون در بخش آخر سمفونی شماره ۸ اشاره میکند. «بتهوون میتوانست همینطور رها کند»، برندت میگوید. «اما به جای آن که این رویداد بیتناسب را به عنوان یک اتفاق خاص ببینید، بتهوون این واقعه ناسازگار را در روشهای مختلف دوباره ارجاع میدهد. با انجام این کار، آهنگساز یک انحراف لحظهای را میگیرد و تأثیر آن را بزرگتر میکند.» میتوان به آنومالیهای مشابهی در نمونهبرداری حلقه معکوس در ضبطهای اواخر گروه بیتلز، صدای خوانندههای تغییر یافته از فرانک اوشن، یا گنجاندن «صداهای پیدا شده» مانند ضبط صدای چراغ راهنمای عابر پیاده یا در بسته شدن، که توسط هنرمندانی مانند چارلی پوت و تهیهکننده بیلی آیلیش، فینیاس اوکانل، ترجیح داده میشود، اشاره کرد.

اگر خروجی خلاقانه واقعاً به عنوان چیزی تعریف شود که هم نوآورانه و هم مفید باشد، تفسیر برندت نشان میدهد که ماشینها در معیار دوم با ما برابری میکنند، در حالی که انسانها در معیار اول برتری دارند.

برای بررسی اینکه آیا این درست است یا نه، من چند روز را صرف بازی با مدل Udio کردم. تولید یک نمونه ۳۰ ثانیهای یک یا دو دقیقه طول میکشد، اما اگر نسخههای پرداختی مدل را داشته باشید میتوانید آهنگهای کامل تولید کنید. من تصمیم گرفتم ۱۲ ژانر را انتخاب کرده، برای هر یک یک نمونه آهنگ تولید کنم و سپس آهنگهای مشابه ساخته شده توسط انسانها را پیدا کنم. من یک آزمون ساختم تا ببینم آیا مردم در اتاق خبر ما میتوانند تشخیص دهند کدام آهنگها توسط AI ساخته شدهاند.

میانگین امتیاز ۴۶٪ بود. و برای برخی ژانرها، بهویژه آثار بیکلام، شنوندگان بیشتر از نادرست بودن اشتباه میکردند. وقتی که دیدم مردم آزمون را مقابل من انجام میدهند، متوجه شدم که ویژگیهایی که با اطمینان به عنوان نشانهای از ترکیب توسط AI علامت میزدند—مثل سازهای ساختگی یا شعر عجیب—نادرست از آب درمیآمدند. بهطور پیشبینیشده، مردم در ژانرهایی که کمتر با آنها آشنا بودند بدتر عمل میکردند؛ برخی در موسیقی کانتری یا سول خوب عمل کردند، اما بسیاری هیچ شانسی در برابر جاز، پیانو کلاسیک یا پاپ نداشتند. بیاتی، محقق خلاقیت، ۶۶٪ امتیاز گرفت، در حالی که برندت، آهنگساز، ۵۰٪ امتیاز گرفت (اگرچه در آزمونهای ارکسترال و سونات پیانو درست پاسخ داد).

یادآوری کنید که مدل تمام اعتبار را در اینجا نمیگیرد؛ این خروجیها نمیتوانستند بدون کار هنرمندان انسانی که آثارشان در دادههای آموزشی گنجانده شده باشد ایجاد شوند. اما با فقط چند پرامپت، مدل آهنگهایی تولید کرد که کمتر کسی قادر به تشخیص آنها به عنوان ساختهشده توسط ماشین بود. برخی به راحتی میتوانستند در یک مهمانی پخش شوند بدون اینکه اعتراضی برانگیزند، و من دو آهنگ پیدا کردم که واقعاً آنها را دوست داشتم، حتی به عنوان یک موسیقیدان تمام عمر و شخصی که به شدت در انتخاب موسیقی حساس است. اما صدای واقعی داشتن با صدای اصلی بودن یکی نیست. آهنگها احساس نمیکردند که از ویژگیهای خاص یا anomalies رهبری شدهاند—قطعا نه در سطح «ترس از پرش» بتهوون. همچنین به نظر نمیرسید که ژانرها را خم کرده یا پرشهای بزرگی بین تمها داشته باشند. در آزمون من، مردم گاهی اوقات در تصمیمگیری در مورد اینکه آیا آهنگ توسط AI تولید شده یا فقط بد است مشکل داشتند.

در نهایت این موضوع چقدر اهمیت خواهد داشت؟ دادگاهها نقشی در تعیین این که آیا مدلهای موسیقی AI تکرارهای ساده هستند یا خلقهای جدید و همچنین چگونگی جبران هنرمندان در این فرایند خواهند داشت، اما ما، به عنوان شنوندگان، تصمیم خواهیم گرفت که ارزش فرهنگی آنها چیست. برای قدردانی از یک آهنگ، آیا نیاز داریم که یک هنرمند انسانی پشت آن را تصور کنیم—کسی با تجربه، آرزوها، نظرات؟ آیا یک آهنگ عالی دیگر عالی نیست اگر متوجه شویم که محصول AI است؟

سانچز میگوید که مردم ممکن است بپرسند که چه کسی پشت موسیقی است. اما «در نهایت، هرچه مقدار AI، هرچه مقدار انسان باشد، این هنوز هنر خواهد بود»، او میگوید. «و مردم به آن واکنش خواهند داد بر اساس کیفیت ویژگیهای زیباییشناختی آن.»

اما در آزمایش من، من دیدم که این سوال برای مردم واقعاً مهم است—و برخی به شدت از ایده لذت بردن از موسیقی ساخته شده توسط مدل کامپیوتری مقاومت کردند. زمانی که یکی از آزمایششدگان من به طور غریزی شروع به تکان دادن سر خود به آهنگ الکتروپاپ در آزمون کرد، چهرهاش تردید را نشان داد. تقریباً انگار سعی میکرد بهترین تلاش خود را برای تصور یک انسان به جای یک ماشین به عنوان آهنگساز آهنگ بکند. «آدم»، او گفت، «من واقعاً امیدوارم که این AI نباشد.»

Credits: "AI is coming for music, too" By James O'Donnell, published in MIT Technology Review.

Full article: https://www.technologyreview.com/2025/04/16/1114433/ai-artificial-intelligence-music-diffusion-creativity-songs-writer/