نسل آیندۀ شبکههای عصبی در سختافزار

شبکههایی که مستقیماً در تراشههای رایانهای برنامهریزی میشوند، میتوانند تصاویر را سریعتر شناسایی کرده و انرژی بسیار کمتری نسبت به شبکههای عصبی سنتی که پایه اصلی بیشتر سیستمهای هوش مصنوعی مدرن هستند، مصرف کنند. این دستاورد در کنفرانس معتبر یادگیری ماشین (NeurIPS) که اخیراً در ونکوور برگزار شد، ارائه شد.

شبکههای عصبی مانند GPT-4 و Stable Diffusion از اتصال پرسپترونها ساخته میشوند؛ مدلهایی که شبیهسازی بسیار سادهای از نورونهای مغز انسان هستند. در مقیاس بزرگ، این پرسپترونها قدرتمند هستند، اما انرژی زیادی مصرف میکنند. تا جایی که مایکروسافت برای تأمین انرژی مورد نیاز پیشرفتهای هوش مصنوعی خود قراردادی برای بازگشایی نیروگاه Three Mile Island منعقد کرده است.

مشکل اصلی این است که پرسپترونها تنها ساختارهایی نرمافزاری هستند و اجرای آنها روی پردازندههای گرافیکی (GPU) نیازمند ترجمه شبکههای عصبی به زبان سختافزار است. این فرآیند نهتنها زمانبر بلکه بسیار پرهزینه است. اما اگر این شبکهها مستقیماً از اجزای سختافزاری ساخته شوند، بسیاری از این هزینهها کاهش پیدا میکند. حتی در آینده ممکن است این شبکهها به طور مستقیم در تراشههای دستگاههایی مانند تلفنهای هوشمند تعبیه شوند و نیاز به ارسال دادهها به سرورها به میزان چشمگیری کاهش یابد.

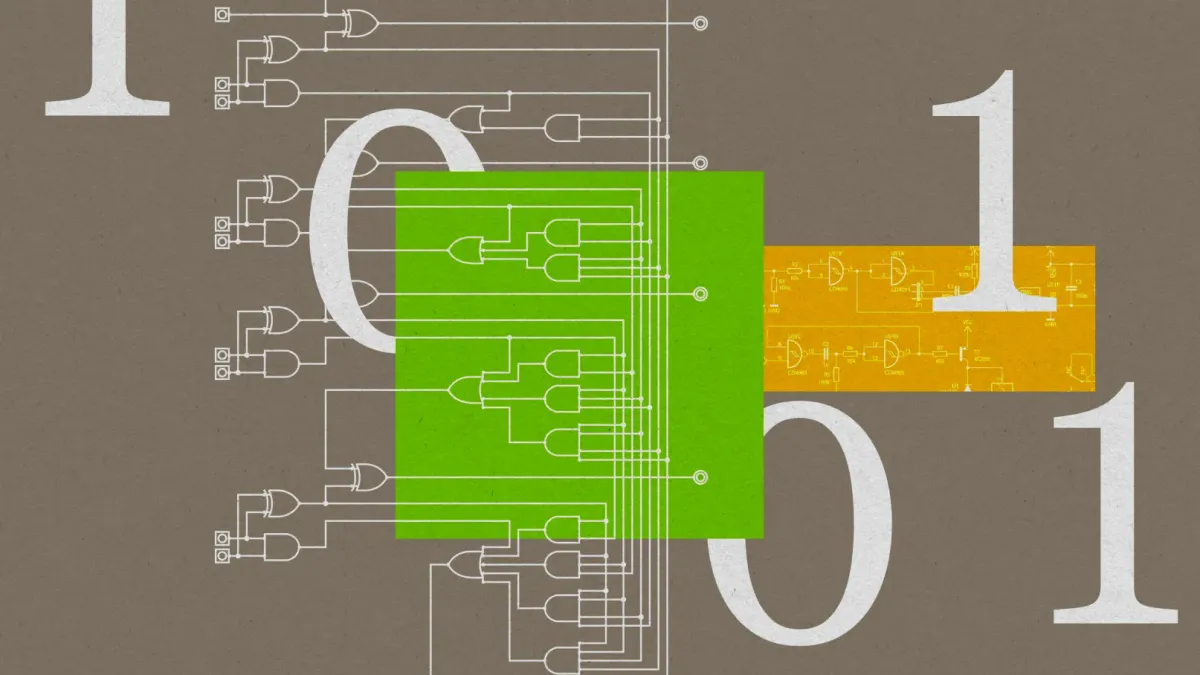

فلیکس پترسن، پژوهشگر فوقدکتری دانشگاه استنفورد، برای تحقق این هدف راهحلی ارائه کرده است. او شبکههایی متشکل از گیتهای منطقی طراحی کرده است؛ گیتهایی که از اجزای اصلی تراشههای رایانهای محسوب میشوند. این گیتها که از چند ترانزیستور ساخته شدهاند، دو ورودی دودویی (0 یا 1) دریافت کرده و خروجیای بر اساس الگوریتم خاص خود تولید میکنند. مانند پرسپترونها، گیتهای منطقی نیز میتوانند به یکدیگر متصل شوند. اجرای این شبکهها ارزان، سریع و آسان است. پترسن در سخنرانی خود در کنفرانس NeurIPS اشاره کرد که این شبکهها تا صدها هزار برابر کمتر از شبکههای عصبی سنتی انرژی مصرف میکنند.

کارایی در برابر عملکرد

شبکههای گیت منطقی از نظر دقت در وظایفی مانند برچسبگذاری تصاویر به پای شبکههای عصبی سنتی نمیرسند، اما سرعت و کارایی بالای آنها نویدبخش است. ژیر ژانگ، استاد مهندسی برق و کامپیوتر در دانشگاه کرنل، میگوید: «اگر بتوانیم فاصله دقت را کاهش دهیم، این روش میتواند فرصتهای زیادی را در لبه فناوری یادگیری ماشین ایجاد کند.»

پترسن کار خود را با هدف کاهش مصرف انرژی شبکههای هوش مصنوعی آغاز نکرد. او از طریق علاقهاش به موضوعات ریاضی و روشهای «تعدیل دیفرانسیلی» که امکان حل مسائل پیچیده با استفاده از حساب دیفرانسیل را فراهم میکنند، به ایده گیتهای منطقی رسید.

یکی از کاربردهای این ایده، الگوریتم بازپخش بود؛ روشی که باعث تحول یادگیری عمیق شد. اما بازپخش که مبتنی بر حساب دیفرانسیل است، نمیتواند مستقیماً برای آموزش شبکههای گیت منطقی استفاده شود؛ زیرا گیتهای منطقی تنها با اعداد دودویی (0 و 1) کار میکنند، در حالی که حساب دیفرانسیل نیازمند مقادیر کسری بین این اعداد است. پترسن راهی پیدا کرد تا شبکههای گیت منطقی را به گونهای «تعدیل» کند که بازپخش بتواند روی آنها اجرا شود. او شبکههای تعدیلشده را شبیهسازی کرد، آنها را آموزش داد و سپس به شکل شبکههای گیت منطقی واقعی تبدیل کرد که قابل اجرا در سختافزار هستند.

چالشها و فرصتها

آموزش شبکههای تعدیلشده فرآیندی دشوار و پرهزینه است. هر گره در شبکه میتواند یکی از 16 گیت منطقی مختلف باشد و احتمالهای مرتبط با هر گیت باید محاسبه و به طور مداوم تنظیم شوند. این فرآیند زمان و انرژی زیادی میطلبد. به گفته پترسن، آموزش این شبکهها صدها برابر بیشتر از شبکههای عصبی سنتی زمان میبرد. با این حال، پس از آموزش، اجرای آنها بسیار کارآمدتر و ارزانتر است.

پترسن شبکههای گیت منطقی را با سایر روشهای بسیار کممصرف مقایسه کرد و دریافت که این شبکهها میتوانند با کمتر از یکدهم گیتهای مورد نیاز سایر روشها و در زمانی بسیار کوتاهتر وظایف مشابهی را انجام دهند. او این آزمایشها را روی تراشههای قابلبرنامهریزی FPGA انجام داد و توضیح داد که استفاده از تراشههای ASIC غیرقابلبرنامهریزی میتواند هزینهها را حتی بیشتر کاهش دهد.

نگرانیها درباره مقیاسپذیری

برخی کارشناسان نسبت به توانایی این روش در مواجهه با مسائل پیچیدهتر تردید دارند. فریناز کوشانفر، استاد مهندسی برق و کامپیوتر در دانشگاه کالیفرنیا، سندیگو، میگوید: «این ایده جذاب است، اما مطمئن نیستم که چقدر در مقیاسهای بزرگتر قابل اجرا باشد.» او هشدار میدهد که روش تعدیل ممکن است در شبکههای بزرگتر دچار خطا شود.

افقهای آینده

با وجود چالشها، پترسن قصد دارد قابلیتهای شبکههای گیت منطقی را بیشتر توسعه دهد. او امیدوار است روزی شبکهای عمومی مبتنی بر گیتهای منطقی طراحی کند که بتواند به صورت مستقیم روی تراشههای رایانهای تولید شده و در دستگاههایی مانند تلفنهای همراه و رایانهها ادغام شود. چنین دستاوردی میتواند صرفهجویی قابلتوجهی در انرژی ایجاد کند.

به گفته پترسن، اگر این شبکهها بتوانند تصاویر و ویدیوها را از دادههای کمکیفیت بازسازی کنند، نیاز به انتقال حجم عظیمی از دادهها میان سرورها و دستگاههای شخصی کاهش خواهد یافت.

او اذعان دارد که شبکههای گیت منطقی هرگز از نظر عملکرد با شبکههای عصبی سنتی رقابت نخواهند کرد، اما این هدف او نیست. او میگوید: «مدلی که میسازیم شاید بهترین نباشد، اما قطعاً ارزانترین خواهد بود.»

Credit: "The next generation of neural networks could live in hardware" By Grace Huckins, published in MIT Technology Review

Read full article here: https://www.technologyreview.com/2024/12/20/1109183/the-next-generation-of-neural-networks-could-live-in-hardware/

Image Credit: Sarah Rogers / MITTR | Photos Adobe Stock, Raw Pixel